Microsoft con Phi-3 Mini ha dado un paso significativo en el desarrollo de modelos de inteligencia artificial. Este modelo, el más pequeño de la serie Phi-3, promete revolucionar el campo de la IA con su eficiencia y rendimiento, a pesar de su tamaño compacto.

Lanzamiento de Phi-3 Mini

Microsoft ha introducido Phi-3 Mini, la versión más reciente de su serie de modelos de inteligencia artificial ligeros. Este modelo, que cuenta con 3.8 mil millones de parámetros, ha sido entrenado con un conjunto de datos más reducido en comparación con grandes modelos de lenguaje como GPT-4.

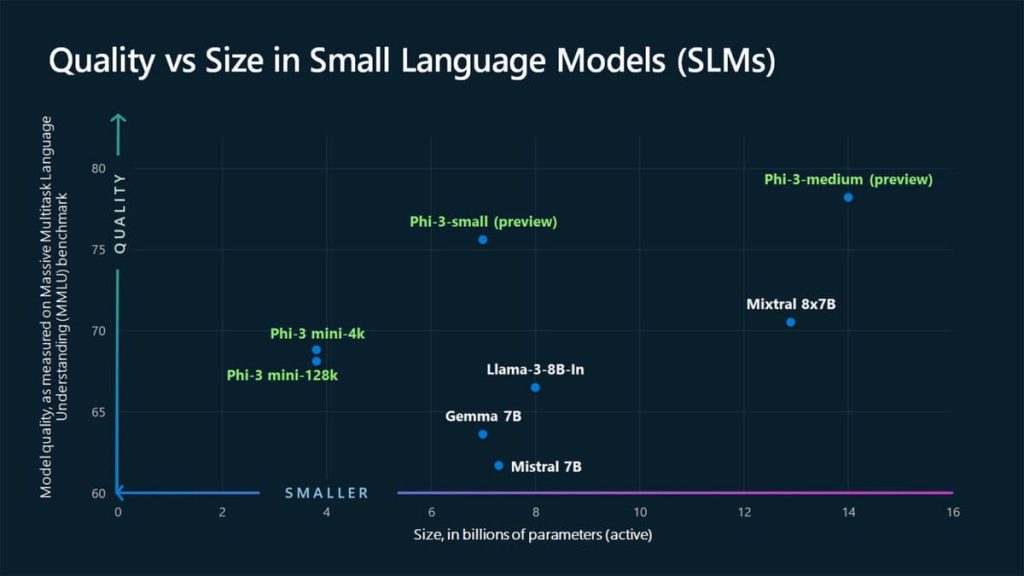

Phi-3 Mini ya está disponible en plataformas como Azure, Hugging Face y Ollama. Además, Microsoft planea expandir esta serie con Phi-3 Small, de 7 mil millones de parámetros, y Phi-3 Medium, con 14 mil millones de parámetros. Los parámetros en estos modelos indican la cantidad de instrucciones complejas que pueden procesar.

Microsoft y Phi-3 Mini: rendimiento mejorado

El lanzamiento de Phi-3 Mini sigue al de Phi-2, que debutó en diciembre y ya demostraba ser tan eficaz como modelos más grandes, como Llama 2. Microsoft asegura que Phi-3 Mini supera a su predecesor en rendimiento y puede ofrecer respuestas comparables a las de un modelo diez veces más grande.

Eric Boyd, vicepresidente corporativo de la Plataforma de IA de Microsoft Azure, afirmó en una entrevista con The Verge que Phi-3 Mini es tan capaz como los grandes modelos de lenguaje (LLM) como GPT-3.5, pero en un formato más pequeño.

Ventajas de los modelos pequeños

Los modelos de inteligencia artificial pequeños, como Phi-3 Mini, presentan varias ventajas sobre sus contrapartes más grandes. Son más económicos de operar y tienen un mejor rendimiento en dispositivos personales como teléfonos y laptops.

A principios de este año, Microsoft formó un equipo especializado en el desarrollo de modelos de IA ligeros. Además de la serie Phi, la compañía ha desarrollado Orca-Math, un modelo centrado en resolver problemas matemáticos.

Competencia en modelos pequeños

Microsoft no es la única empresa que ha incursionado en el desarrollo de modelos de IA pequeños. Empresas competidoras también han creado sus propios modelos dirigidos a tareas específicas. Los modelos Gemma 2B y 7B de Google son útiles para chatbots simples y trabajos relacionados con el lenguaje.

Claude 3 Haiku de Anthropic puede leer y resumir rápidamente documentos de investigación densos, mientras que Llama 3-8B de Meta se utiliza para chatbots y asistencia en codificación.

Enfoque educativo y aplicaciones personalizadas

El entrenamiento de Phi-3 siguió un enfoque educativo innovador, inspirado en cómo los niños aprenden a través de cuentos infantiles y libros con palabras y estructuras de oraciones simples. Este modelo se basa en los conocimientos adquiridos en versiones anteriores, mejorando en áreas como la codificación y el razonamiento.

Aunque Phi-3 no puede igualar en amplitud de conocimiento a modelos como GPT-4, es especialmente eficaz para aplicaciones personalizadas debido a su menor demanda de recursos computacionales, lo que lo hace más accesible y asequible para muchas empresas.

El lanzamiento de Phi-3 Mini de Microsoft marca un avance significativo en el desarrollo de modelos de inteligencia artificial ligeros y eficientes. Con su impresionante rendimiento y eficiencia, demuestra que un tamaño reducido no implica necesariamente una capacidad limitada.