OpenAI ha dado un paso más en la evolución de la inteligencia artificial con el lanzamiento de OpenAI o3-mini. Este nuevo modelo, diseñado para ofrecer capacidades avanzadas de razonamiento, se destaca por su eficiencia en costos y su alto rendimiento en áreas como ciencia, matemáticas y programación.

Ya está disponible en ChatGPT y en la API, o3-mini representa una mejora significativa en comparación con versiones anteriores, manteniendo una latencia reducida y un acceso más amplio para desarrolladores y usuarios de distintos niveles.

OpenAI o3-mini tiene características avanzadas para desarrolladores

Una de las principales innovaciones de OpenAI o3-mini es su compatibilidad con funciones clave para desarrolladores. Entre ellas se incluyen llamadas a funciones, salidas estructuradas y mensajes especializados. Esto permite una integración más eficiente en entornos de producción.

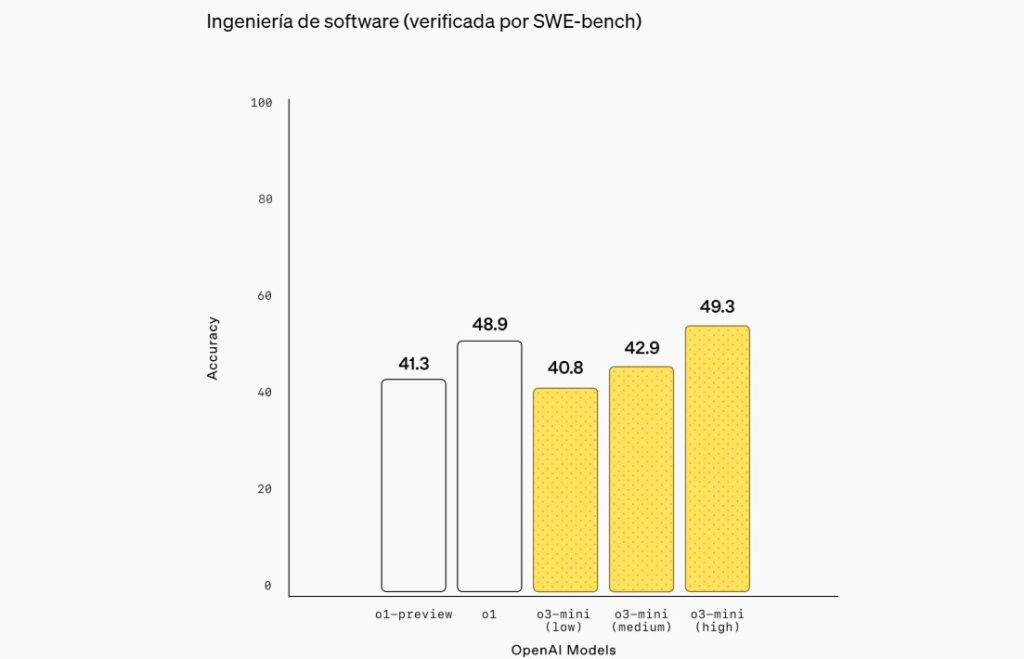

Además, los desarrolladores pueden elegir entre tres niveles de esfuerzo de razonamiento: bajo, medio y alto, ajustando el rendimiento del modelo según las necesidades específicas de cada tarea. Aunque o3-mini no cuenta con capacidades de visión, sigue siendo una opción potente para tareas de razonamiento lógico y técnico.

Disponibilidad en ChatGPT y API

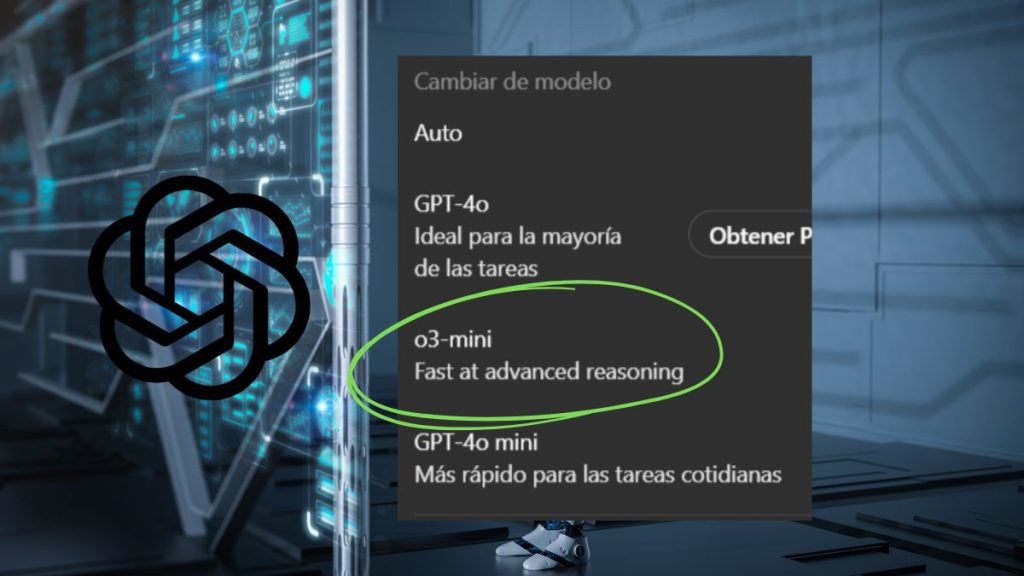

El modelo o3-mini se encuentra disponible en diversas plataformas, incluyendo la API de Chat Completions, Assistants API y Batch API, a las cuales tienen acceso desarrolladores de los niveles 3 a 5 de uso de la API. En ChatGPT, los usuarios de los planes Plus, Team y Pro ya pueden utilizar este modelo, mientras que el acceso para empresas está previsto para los siguientes días.

Con su lanzamiento, o3-mini reemplaza a o1-mini en el selector de modelos, ofreciendo mejores tiempos de respuesta y mayores límites de uso para mejorar la experiencia de los usuarios.

OpenAI o3-mini tiene un acceso ampliado y mejoras en la búsqueda

Por primera vez, un modelo de razonamiento de OpenAI está disponible para usuarios del plan gratuito de ChatGPT. Estos usuarios pueden probar OpenAI o3-mini seleccionando la opción ‘Reason’ en el compositor de mensajes o regenerando respuestas dentro de la plataforma.

Además, una de las mejoras clave del modelo es su integración con la búsqueda web. Esto permite obtener respuestas más actualizadas con enlaces a fuentes relevantes. Aunque esta función se encuentra en fase de prueba, representa un avance significativo en la capacidad del modelo para ofrecer información precisa y contextualizada.

Optimización en precisión y velocidad

OpenAI o3-mini ha sido diseñado para brindar un equilibrio óptimo entre velocidad y precisión en tareas técnicas. En ChatGPT, utiliza razonamiento medio por defecto, pero los usuarios pagos pueden optar por la versión o3-mini-high, que ofrece un mayor nivel de inteligencia con tiempos de respuesta ligeramente superiores.

Comparado con su predecesor o1-mini, el nuevo modelo genera respuestas un 24% más rápido. Así, reduce el tiempo de espera de 10.16 a 7.7 segundos en promedio. Esta optimización lo convierte en una herramienta más eficiente para resolver problemas complejos de manera ágil.

Evaluaciones de rendimiento y seguridad

Las pruebas realizadas por expertos han demostrado que OpenAI o3-mini no solo es más rápido, sino también más preciso. Se ha registrado una reducción del 39% en errores en preguntas complejas del mundo real, y los evaluadores han preferido sus respuestas en un 56% de los casos en comparación con o1-mini.

En términos de seguridad, el modelo ha sido sometido a rigurosas pruebas, superando a GPT-4o en evaluaciones de resistencia a vulnerabilidades y ataques de seguridad. Esto ha sido posible gracias a su entrenamiento basado en alineación deliberativa, que le permite analizar especificaciones de seguridad antes de generar respuestas.

Con el lanzamiento de OpenAI o3-mini, la compañía reafirma su compromiso de hacer que la inteligencia artificial avanzada sea más accesible y rentable. Este modelo sigue la tendencia de reducción de costos establecida por OpenAI, disminuyendo el precio por token en un 95% desde el lanzamiento de GPT-4.

Vía OpenAI