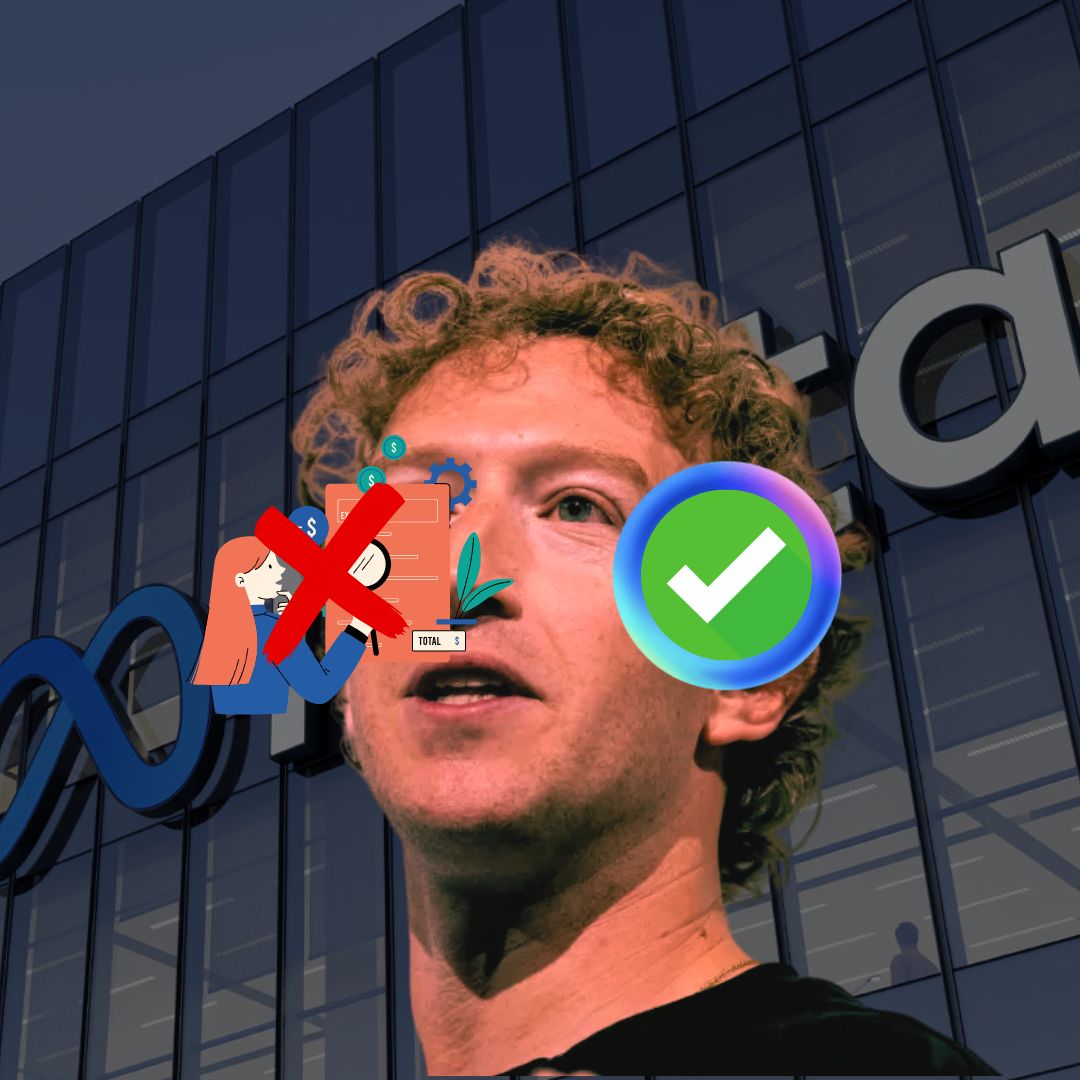

Meta, la empresa detrás de Instagram y WhatsApp, está dando un paso importante hacia la automatización de sus procesos internos. Su objetivo de Meta es reemplazar la mayoría de revisiones realizadas por humanos con un sistema de inteligencia artificial (IA).

Esta transformación busca agilizar el desarrollo de productos, pero también ha generado inquietudes sobre el impacto que podría tener en la privacidad y seguridad de los usuarios. ¿Es posible lograr eficiencia sin poner en riesgo la protección de datos?

Automatización con IA de las revisiones de riesgos en productos de Meta

La nueva estrategia de Meta contempla que un sistema de IA se encargue de evaluar hasta el 90% de los riesgos vinculados con actualizaciones en sus aplicaciones.

Este cambio permitiría a la compañía lanzar funciones más rápido y con menor intervención humana. La promesa es una mayor eficiencia, pero también surge la pregunta de si se podrá mantener el mismo nivel de cuidado que ofrecían las evaluaciones manuales.

Un acuerdo regulatorio que exige evaluaciones de privacidad

Desde 2012, Meta está sujeta a un acuerdo con la Comisión Federal de Comercio (FTC) que le exige realizar revisiones de privacidad antes de modificar sus plataformas. Este compromiso legal ha sido históricamente cumplido a través de análisis humanos, enfocados en identificar cualquier posible impacto negativo en la privacidad de los usuarios.

Funcionamiento del nuevo sistema con IA en Meta

Con el nuevo enfoque, los equipos de producto deberán responder a un cuestionario sobre su trabajo, y recibirán una respuesta casi inmediata del sistema de IA.

Esta decisión incluirá riesgos detectados y condiciones que se deben cumplir antes de que la función pueda ser lanzada. La automatización está pensada para acelerar decisiones de bajo riesgo, dejando los temas más delicados en manos de expertos.

Preocupaciones sobre los posibles riesgos aumentados

Algunos especialistas advierten que esta rapidez puede llevar a pasar por alto efectos no deseados. Si la IA no detecta correctamente ciertos riesgos, podría haber consecuencias graves después del lanzamiento. Esto genera dudas sobre si el sistema automatizado puede anticiparse a problemas éticos o de privacidad tan bien como lo haría un equipo humano.

Postura oficial de Meta sobre la automatización

Meta ha defendido su inversión en privacidad, afirmando que ha destinado más de 8 mil millones de dólares a mejorar sus procesos. Según la empresa, la IA aportará coherencia en decisiones simples, mientras que los casos complejos seguirán siendo analizados por personas. Su meta es combinar velocidad con responsabilidad.

La apuesta de Meta por la inteligencia artificial en la evaluación de riesgos marca un cambio profundo en la forma de desarrollar productos digitales. Aunque ofrece ventajas claras en agilidad y eficiencia, el reto está en mantener la protección del usuario como prioridad.

Vía TechCrunch